Red Hat AI 3.4: Новая платформа для масштабирования агентного ИИ в гибридных облаках

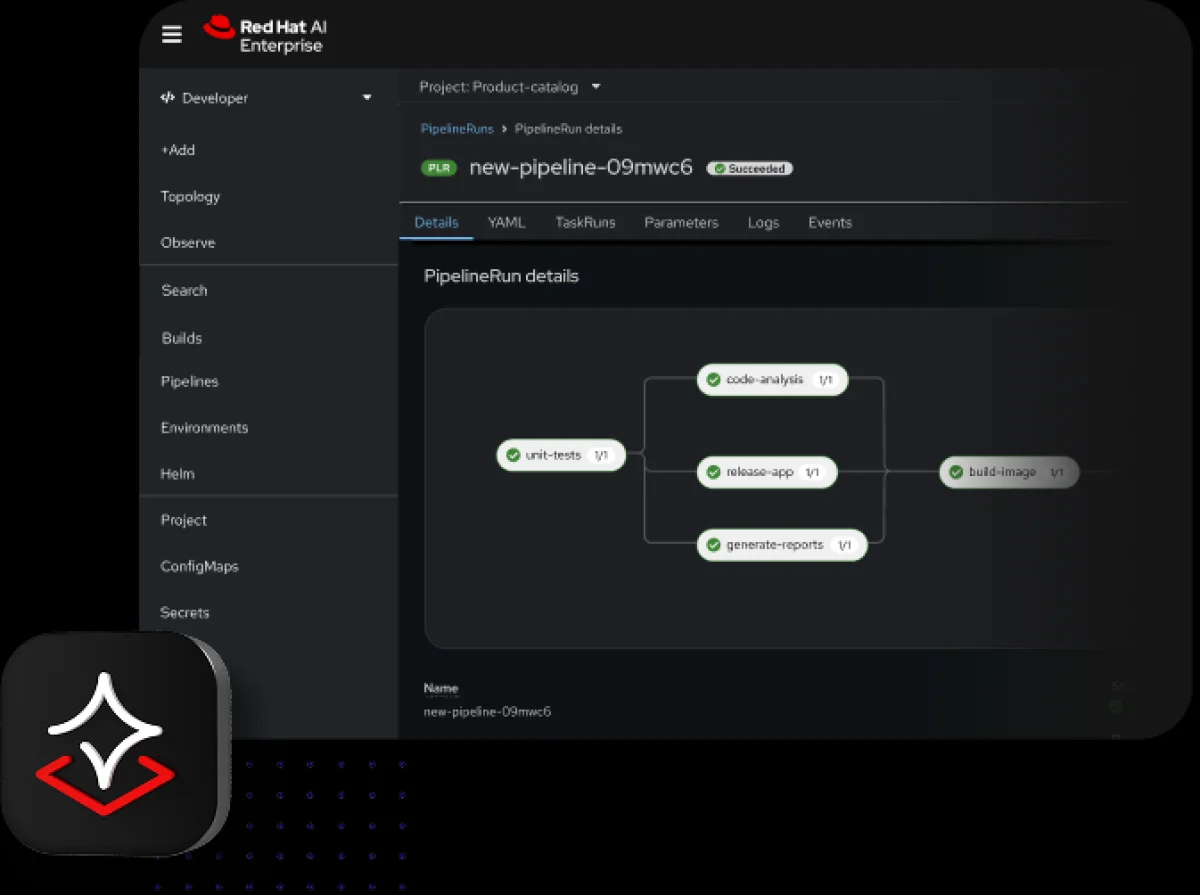

Компания Red Hat анонсировала Red Hat AI 3.4 — обновлённую версию своей корпоративной платформы для искусственного интеллекта. Она создана для обеспечения крупномасштабного вывода моделей и развёртывания агентного ИИ в гибридных облачных инфраструктурах. Будучи комплексным решением, Red Hat AI 3.4 предоставляет архитектурную базу и операционные средства, необходимые для масштабирования моделей и агентских рабочих процессов в гибридном облаке.

Как пояснил Джо Фернандес (Joe Fernandes), вице-президент и генеральный директор Red Hat AI, стратегия компании в сфере ИИ строится на четырёх основных принципах. «Во-первых, мы помогаем клиентам быстро, гибко и эффективно выполнять инференс, размещая модели в их собственной среде, — приводит его слова SiliconANGLE. — Во-вторых, мы подключаем их корпоративные данные к этим моделям и агентам. В-третьих, мы ускоряем развёртывание и управление агентами в гибридной облачной среде. В-четвёртых, мы объединяем всё это на нашей интегрированной ИИ-платформе, позволяя запускать любую модель в любом агенте на любом оборудовании и в любой облачной среде».

По словам компании, центральным нововведением этого релиза стала модель как услуга (MaaS). Она предлагает единый управляемый интерфейс для разработчиков, дающий доступ к тщательно отобранным моделям, а администраторам — возможность отслеживать их использование и устанавливать политики. Разработчики подключаются к моделям через стандартные API, совместимые с OpenAI. Благодаря этому единое управление распространяется как на внутренние, так и на внешние модели. Кроме того, инструменты AutoRAG и AutoML автоматизируют сложные задачи ИИ: от выбора наиболее эффективных стратегий извлечения данных для конкретных наборов до построения и оптимизации моделей.

Источник изображения: Red Hat

В фундаменте данной системы находится открытая библиотека vLLM. Её дополняет стек llm-d, разработанный специально для инференса в среде Kubernetes. Поддержка спекулятивного декодирования, ставшая общедоступной в текущем обновлении, ускоряет генерацию ответов в два-три раза, почти не влияя на их качество, и одновременно снижает затраты на взаимодействие. Помимо этого, vLLM теперь функционирует на процессорах CPU, что особенно полезно для компактных языковых моделей. Для администрирования инструментов, предназначенных для агентов, компания Red Hat предлагает каталог MCP-серверов и сопутствующий MCP-шлюз.

Набор инструментов AgentOps нового поколения позволяет управлять агентами в любом масштабе, вне зависимости от используемой платформы, на всех этапах их жизненного цикла. Сюда входит встроенная трассировка вызовов LLM, обращений к инструментам и процессов рассуждений, а также администрирование криптографической идентификации через протокол SPIFFE/SPIRE. Последний механизм даёт организациям возможность заменить статические, жёстко прописанные ключи на временные токены. Такой подход обеспечивает работу автономных агентов с минимальными привилегиями на каждом уровне стека и позволяет удостовериться, что действия агентов привязаны к подтверждённой учётной записи.

Для объединения корпоративных данных с моделями и агентами в версии Red Hat AI 3.4 внедрены функции управления через промпты, а также центр оценки точности, качества и безопасности моделей и агентов. Данный центр не привязан к конкретным фреймворкам и заменяет разрозненные методики тестирования единой интегрированной системой. Prompt Lab and Registry, представляющий собой централизованное хранилище промптов в виде полноценных информационных ресурсов, служит для разработчиков и администраторов единым источником достоверных сведений о входных данных, которые управляют моделями и агентами.

Источник изображения: Red Hat

Функции трассировки нового поколения созданы на базе MLflow. Интеграция с MLflow гарантирует прозрачность работы агента, обеспечивая сквозное отслеживание вызовов LLM, этапов рассуждений, запуска инструментов, ответов модели и расхода токенов через OpenTelemetry. Это формирует понятный журнал аудита для всего цикла подсказок, эмбеддингов и конфигураций RAG, что упрощает отладку и проверки. Кроме того, MLflow предоставляет единую систему для отслеживания экспериментов и управления артефактами в сценариях как генеративного, так и прогнозного ИИ.

Платформа Red Hat AI предоставляет пользователям возможность проверять безопасность моделей и агентов благодаря автоматизированному анализу угроз, который теперь встроен непосредственно в процесс разработки. Применяются решения от Chatterbox Labs и Garak. Платформа оценивает модели и агентные системы на предмет таких угроз, как взлом, промпт-инъекции и предвзятость, совместно с NVIDIA NeMo Guardrails для обеспечения безопасности в реальном времени.

Отмечается, что Red Hat AI 3.4 изначально совместима с ускорителями NVIDIA Blackwell и AMD Instinct MI325X. Расширяя эту унифицированную архитектуру платформы для работы напрямую в управляемых облачных средах сторонних разработчиков, включая Red Hat AI Inference в IBM Cloud, Red Hat гарантирует операционную согласованность на различных типах оборудования и облачных провайдеров.

Источник:

- Red Hat