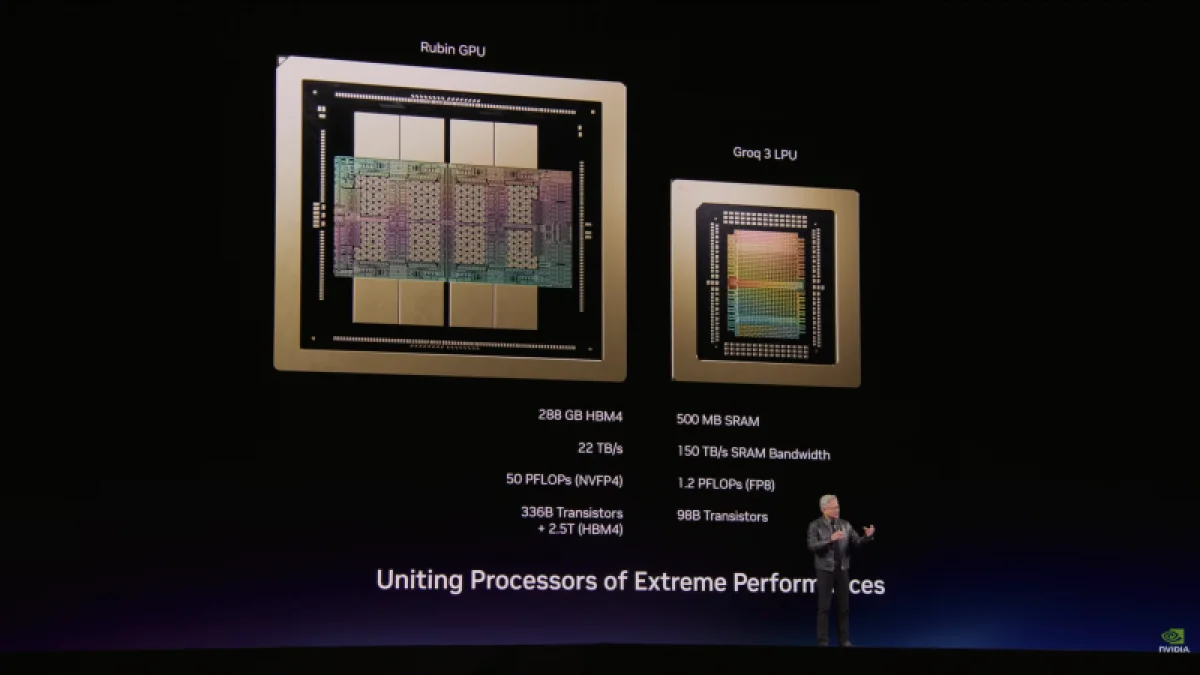

Компания NVIDIA сообщила о начале производства платформы Vera Rubin, которая теперь объединяет семь различных чипов (в январе их было шесть), что позволит совершить прорыв в области агентного искусственного интеллекта. В состав платформы вошли Arm-процессоры Vera, ускорители Rubin, интерконнект NVLink 6, адаптеры ConnectX-9 SuperNIC и DPU BlueField-4, а также коммутаторы Ethernet Spectrum/Quantum-6. Седьмым компонентом стал LPU Groq 3 — NVIDIA приобрела компанию Groq за рекордные $20 млрд всего три месяца назад и теперь активно наращивает выпуск этих процессоров.

По словам NVIDIA, подобная комбинация компонентов даёт возможность обрабатывать ИИ-нагрузки на всех стадиях — от масштабного предобучения, дообучения и стресс-тестирования до выполнения задач агентного ИИ в режиме реального времени. «Vera Rubin — это огромный шаг вперёд: семь инновационных чипов, пять стоек и один гигантский суперкомпьютер, созданный для поддержки полного цикла работы с ИИ», — заявил основатель и генеральный директор NVIDIA Дженсен Хуанг (Jensen Huang). Он подчеркнул, что с появлением Vera Rubin наступил переломный момент в развитии агентного ИИ, ознаменовавший начало «крупнейшего в истории развёртывания инфраструктурных решений».

Источник изображений: NVIDIA

«Платформа NVIDIA Vera Rubin предоставляет нам вычислительную мощь, сетевые возможности и архитектуру, которые позволяют продолжать инновации, одновременно укрепляя безопасность и надёжность, столь важные для наших клиентов», — отметил генеральный директор и соучредитель Anthropic Дарио Амодеи (Dario Amodei). «Инфраструктура NVIDIA служит фундаментом для расширения границ возможностей ИИ, — добавил генеральный директор OpenAI Сэм Альтман (Sam Altman). — С платформой NVIDIA Vera Rubin мы сможем развёртывать более мощные модели и агентов в огромных масштабах, предлагая сотням миллионов пользователей более быстрые и устойчивые системы».

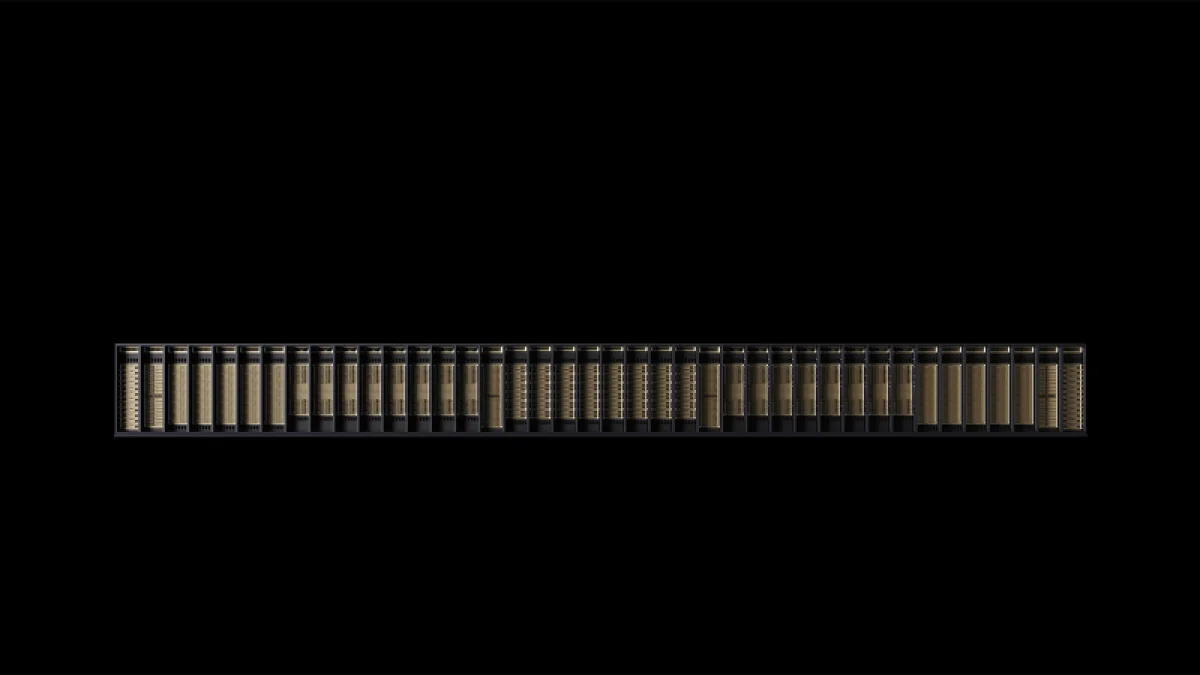

По заявлению производителя, Vera Rubin представляет собой наиболее масштабную и универсальную ИИ-платформу — суперкомпьютер, состоящий из множества стоек, специально созданных для задач искусственного интеллекта и функционирующих как единая мощная система. Платформа NVIDIA Vera Rubin NVL72 демонстрирует высокую эффективность при обучении крупных MoE-моделей, используя в четыре раза меньше ускорителей в сравнении с архитектурой Blackwell, а также обеспечивает до десятикратного увеличения пропускной способности вывода на ватт при десятикратном снижении стоимости обработки токена.

Стойка Vera на базе CPU — это высокоплотная платформа MGX с жидкостным охлаждением, которая объединяет 256 процессоров Vera, обеспечивая масштабируемую и энергоэффективную производительность с выдающейся однопоточной обработкой. Это создаёт основу для масштабируемых агентных ИИ-систем. Стойки Vera обеспечивают тесную синхронизацию сред в рамках всей ИИ-инфраструктуры. Вместе со стойками Rubin они формируют фундамент для крупномасштабных систем агентного ИИ и обучения с подкреплением, при этом Vera демонстрирует вдвое более высокую эффективность и вдвое более высокую скорость по сравнению с традиционными CPU (хотя в конфигурации NVL8 по-прежнему будут применяться процессоры Intel Xeon).

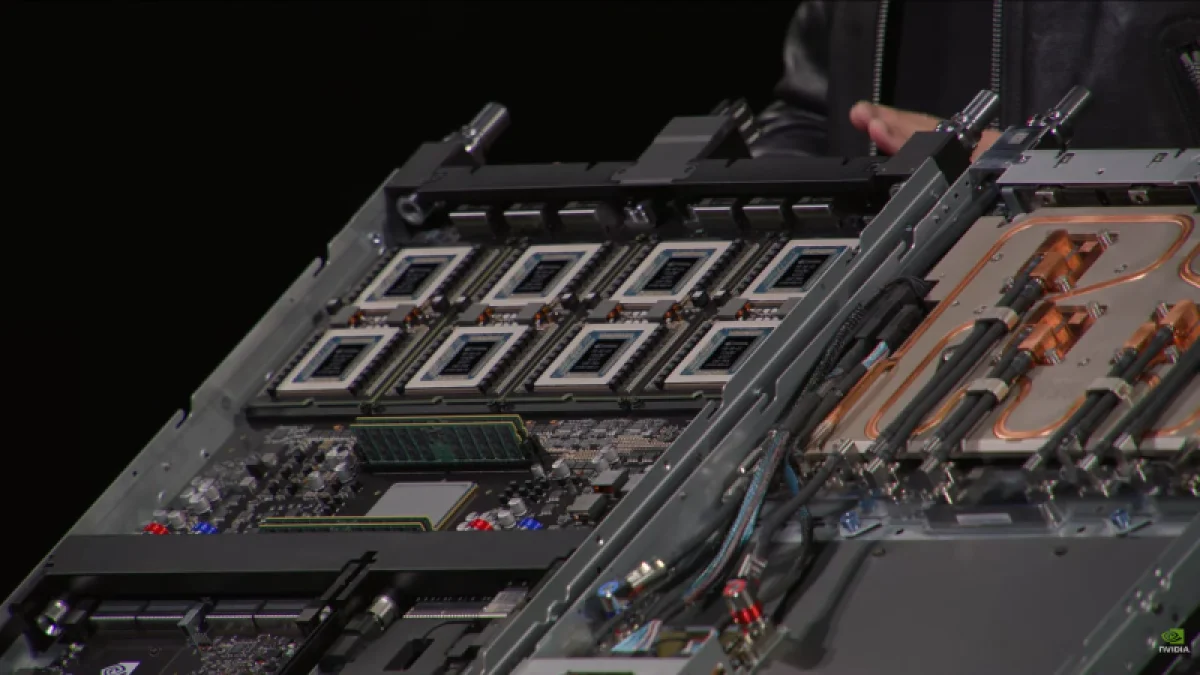

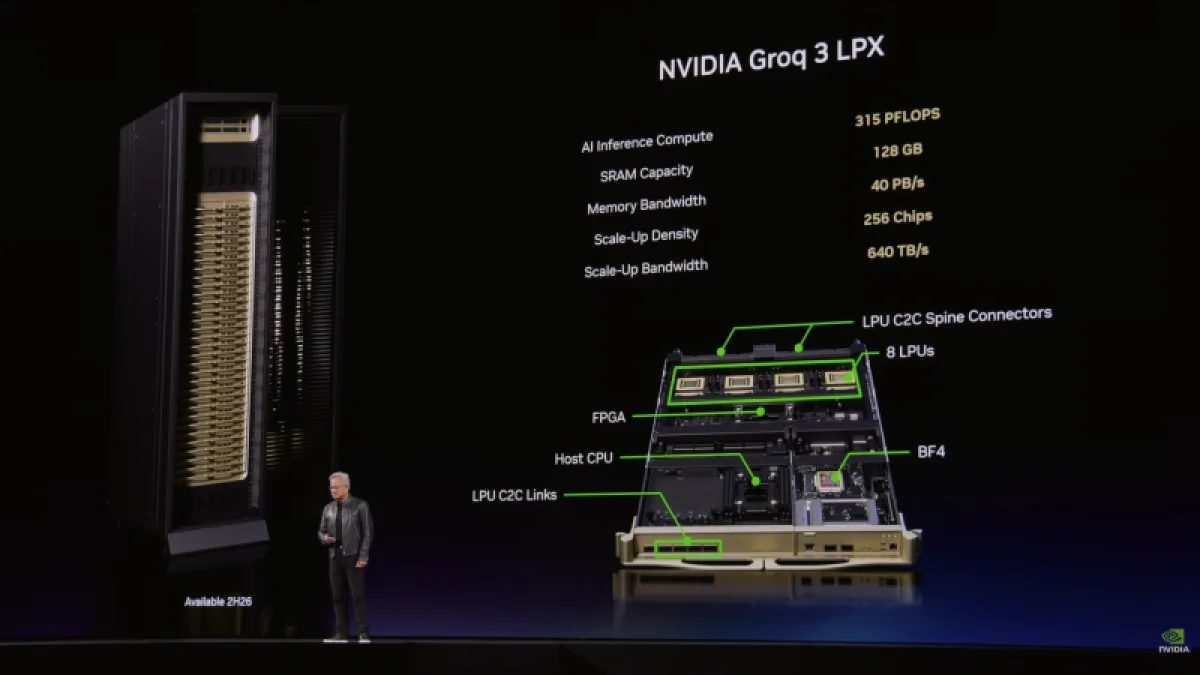

Стойки Groq 3 LPX (также на базе MGX и с жидкостным охлаждением) и Vera Rubin, разработанные для обеспечения минимальной задержки и обработки объёмных контекстов, необходимых агентным системам, предлагают до 35-кратного увеличения пропускной способности вывода на мегаватт и до 10-кратного роста потенциального дохода для моделей с триллионами параметров. В масштабах предприятия парк LPU функционирует как один гигантский процессор, обеспечивая быстрое и предсказуемое ускорение процессов логического вывода.

Стойка LPX, оснащённая 256 чипами LPU, располагает 128 ГБ SRAM с совокупной пропускной способностью 640 ТБ/с. В связке с Vera Rubin NVL72 чипы LPU повышают эффективность декодирования, совместно обрабатывая каждый слой ИИ-модели для каждого выходного токена. Всё это позволяет работать с моделями, содержащими триллионы параметров и контекстные окна в миллионы токенов, сохраняя при этом оптимальную эффективность использования энергии, памяти и вычислительных мощностей.

Представленная одновременно с Vera Rubin система хранения данных BlueField-4 STX создана для задач искусственного интеллекта, гарантируя беспрепятственное масштабирование памяти графических процессоров в пределах всего POD-кластера. Однако теперь корпорация уточняет, что BlueField-4 оснащена процессором Vera, а не Grace, а также контроллером ConnectX-9 SuperNIC. STX формирует высокоскоростной общий уровень данных, адаптированный для хранения и доступа к значительным массивам кэша «ключ-значение», производимым крупными языковыми моделями и процессами агентного ИИ. Платформа DOCA Memos в свою очередь даёт возможность задействовать выделенное KV-хранилище, что ускоряет пропускную способность вывода до пятикратных значений, одновременно улучшая энергопотребление в сравнении с универсальными архитектурами хранения.

Кроме того, NVIDIA совместно с более чем двумя сотнями партнёров представила платформу NVIDIA DSX для Vera Rubin, включающую технологию DSX Max-Q. Она даёт возможность гибко управлять электропитанием всей ИИ-фабрики в целом, что позволяет нарастить ИИ-инфраструктуру в центре обработки данных на 30% без увеличения энергозатрат. Программное обеспечение DSX Flex обеспечивает ИИ-фабрикам возможность адаптации к энергосетям, помогая задействовать до 100 ГВт неиспользуемой сетевой мощности. Также NVIDIA опубликовала референсный проект Vera Rubin DSX AI Factory — схему совместно разрабатываемой ИИ-инфраструктуры, которая оптимизирует количество токенов на ватт и общую производительность, усиливая отказоустойчивость системы и ускоряя развёртывание.

Решения на основе Vera Rubin станут доступны у партнёров NVIDIA, начиная со второй половины текущего года. В их перечень войдут гиперскейлеры AWS, Google Cloud, Microsoft Azure и Oracle Cloud, а также партнёры NVIDIA Cloud — CoreWeave, Crusoe, Lambda, Nebius, Nscale и Together AI. Широкий ассортимент серверов на базе продуктов Vera Rubin, как ожидается, будут выпускать мировые производители систем Cisco, Dell Technologies, HPE, Lenovo и Supermicro, а также Aivres, ASUS, Foxconn, GIGABYTE, Inventec, Pegatron, Quanta Cloud Technology (QCT), Wistron и Wiwynn.

Источник:

- nvidia.com